3 claves para identificar un video falso hecho con inteligencia artificial

Si tienes poco tiempo...

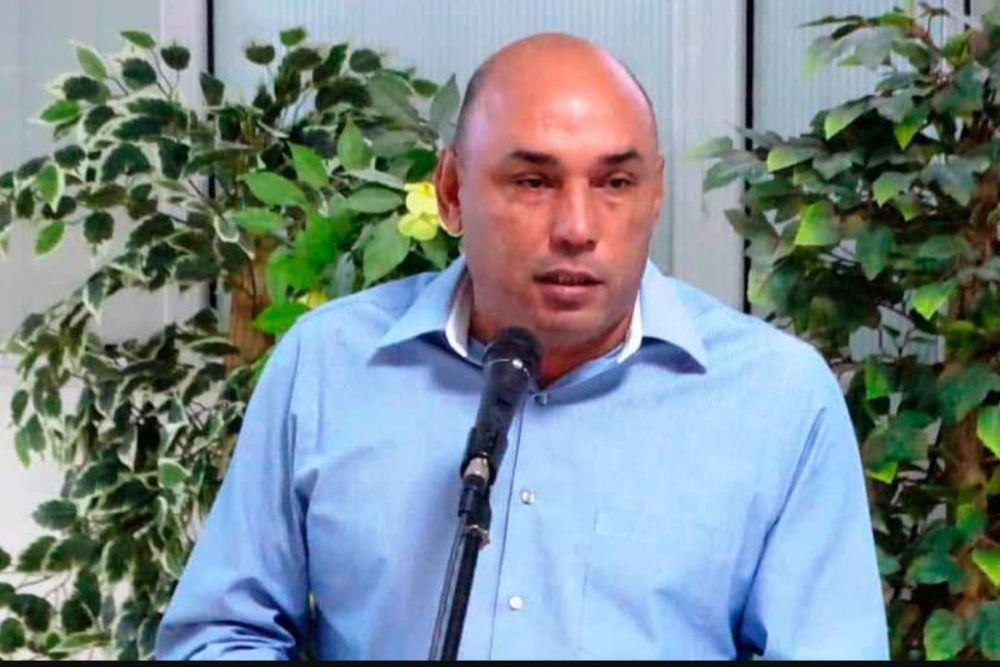

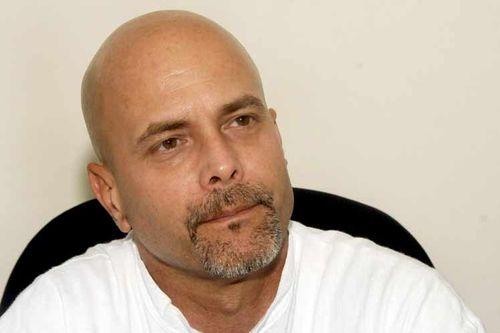

Para muchos usuarios también es difícil identificar los deepfakes, que en su gran mayoría son videos o imágenes falsas creadas mediante softwares digitales que usan inteligencia artificial y la manipulación de rasgos faciales.

Pueden ser indicios de falsedad los bordes de la cara que se funden con la ropa, aretes o piezas de joyería desiguales o mal hechas, vello facial poco realista, una cara perfectamente simétrica, dientes extraños, la forma de los dedos de las manos.

La desinformación crece a través del uso irresponsable de la inteligencia artificial (IA). Se ha utilizado para fabricar videos similares al de un noticiero donde se reporta una situación específica, noticias falsas, imágenes manipuladas de personas famosas, o generar invitaciones a un sitio web donde debes introducir sus datos personales y dinero, y sin darte cuenta caer en una estafa.

Para muchos usuarios también es difícil identificar los deepfakes, que en su gran mayoría son videos o imágenes falsas creadas mediante softwares digitales que usan inteligencia artificial y la manipulación de rasgos faciales.

Los deepfakes suelen combinar imágenes y audios para recrear eventos, declaraciones de personas de gran impacto o acciones que nunca han ocurrido. Este tipo de videos ficticios suelen ser muy convincentes, por lo que difieren de otras formas de desinformación por la dificultad de detectar el engaño. Para conocer más sobre lo qué son los deepfakes puedes leer AQUÍ.

En este texto, te sugerimos tres recomendaciones para reconocer si un video es FALSO.

Verifica la fuente del video y la información

Si ves un video donde una persona famosa o un funcionario público declara algo que tú nunca esperarías que dijera, tómate un tiempo antes de compartirlo. Vuelve a ver el video. Si no estás seguro de algo, lo mejor es no difundirlo.

Puedes hacer una búsqueda rápida en Google para ver si encuentras la misma noticia o material en otros medios de comunicación confiables. Normalmente, si es verdadero será compartido por muchos de estos medios.

Los deepfakes a menudo sacan información fuera de contexto. Si hallaste el video en una cuenta que lo comparte, mejor verificar si tiene crédito o no de la fuente original, ver si el contenido encaja con las noticias actuales, y si otras fuentes lo citan de la misma manera.

Busca incoherencias en la imagen y audio

También debes prestar atención a los detalles: pueden ser indicios de falsedad los bordes de la cara que se funden con la ropa, aretes o piezas de joyería desiguales o mal hechas, vello facial poco realista, una cara perfectamente simétrica, dientes extraños, la forma de los dedos de las manos. Aunque la tecnología para hacer deepfakes es bastante avanzada, suele tener dificultades para recrear este tipo de detalles pequeños.

Algo más que puede ayudar a despejar las dudas es hacer zoom a la boca de la persona que habla. Si es un audiovisual falso puede suceder que el sonido y el movimiento de los labios no estén sincronizados.

Además, fíjate en el número de veces que parpadea. Los deepfakes suelen parpadear menos que las personas reales y pueden hacerlo de manera forzada o poco natural.

Recuerda que la mayoría de la desinformación es publicada y creada para generar dudas y para reafirmar creencias preexistentes. Y aunque la tecnología utilizada para desinformar mejora con rapidez, puedes entrenarte y aprender cómo reconocerla para así ponerle fin a la divulgación de contenido falso o desinformador, al menos de tu parte.

Sé cauteloso: desconfía de ofertas aparentemente muy tentadoras

“El uso de deepfakes está creciendo, al igual que el fraude de identidades sintéticas, y la banca minorista, las aseguradoras y los proveedores de pasarelas de pago son objetivos clave para este tipo de delitos”, según el medio Recordia.

Algunas de las formas que usan los estafadores son: el fraude fantasma (Ghost Fraud), donde se utilizan los datos de una persona fallecida para hacerse pasar por ella y obtener ganancias; el llamado “fraude de solicitudes”, basado en el uso de identidades falsas o robadas específicamente para abrir cuentas bancarias; el “fraude de identidad sintética”, en la cual los ciberdelincuentes usan una combinación de información falsa, real y robada para crear una “persona” que no existe.

Otra vía, es cuando a través de un video o audio te piden descargar una aplicación o realizar una inversión. Suele estar relacionada con ofertas muy tentadoras de productos exclusivos, precios de oferta, inversiones garantizadas o aplicaciones con supuestos beneficios extraordinarios. Debes ir, como mencionamos antes, directamente a la cuenta oficial en cada caso y contrastar la información.

La integración de los vishing y el spoofing telefónico, con los deepfake de audio, también han elevado el riesgo de estafas.

Por ejemplo, en 2019 a través de deepfake de voz se imitó al CEO de una empresa de energía con sede en el Reino Unido y se convenció al director de la empresa -quien creyó que hablaba con su superior- a realizar una transferencia “urgente” de 220.000 euros a una cuenta fraudulenta. Otro caso fue en 2020, cuando una empresa japonesa también transfirió una gran suma de dinero a estafadores que utilizaron un deepfake de audio, reportó Computing.es.

Algunas de las principales herramientas y técnicas de detección de deepfakes disponibles en la actualidad son: Sentinel, una plataforma líder de protección basada en IA; FakeCatcher, un detector de falsificaciones profundas en tiempo real que ha introducido la compañía tecnológica estadounidense Intel; y el proyecto WeVerify, destinado a desarrollar métodos y herramientas inteligentes de análisis de desinformación y verificación de contenido humano en el circuito.