VerificAudio, herramienta que identifica desinformaciones sonoras

Si tienes poco tiempo...

VerificAudio te puede ayudar a detectar audios falsos o manipulados. La plataforma cuenta con la colaboración de Google News Initiative y la empresa española Minsait.

Los mensajes en audio se encuentran entre los deepfakes más complicados de verificar. «Estos audios pueden ser más desafiantes de detectar qué imágenes o videos», dijo al Instituto Poynter, Manjeet Rege, director del Centro de Inteligencia Artificial Aplicada de la Universidad de St. Thomas, Minnesota. «El audio carece del contexto y las pistas visuales de los videos, así que un material creíble es más fácil de sintetizar convincentemente».

Además, las herramientas disponibles en internet para el análisis de estos audios no suelen, por lo general, arrojar resultados confiables. De estas, la más efectiva según varios sitios, es AI or not, pero aún así no es lo suficientemente segura.

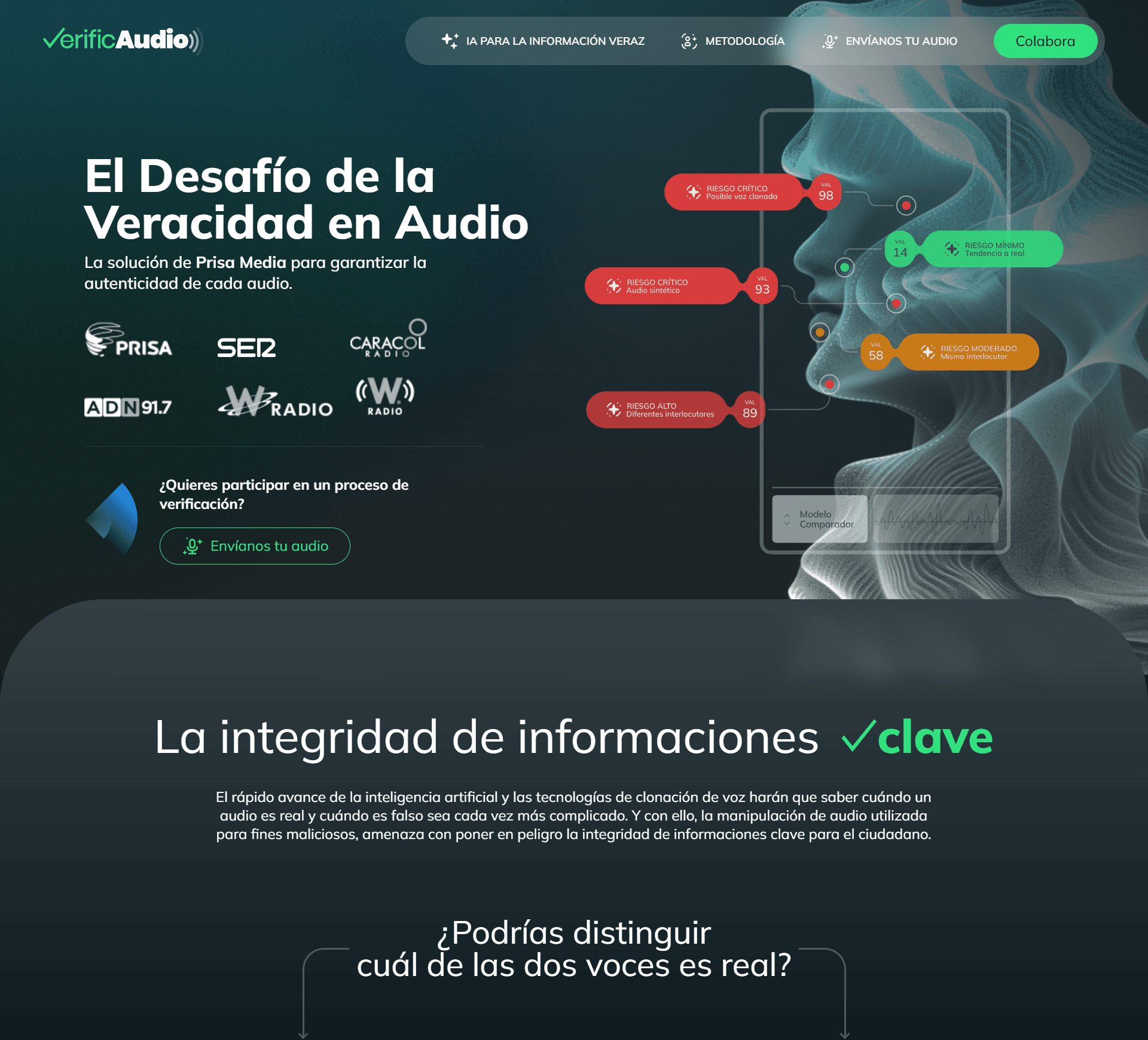

Ante la falta de opciones, la aparición de VerificAudio supone una valiosa herramienta contra la desinformación. Fue desarrollada por PRISA Media, uno de los principales grupos de creación y distribución de contenidos educativos, de información y entretenimiento en los mercados de lengua española y portuguesa.

VerificAudio te puede ayudar a detectar audios falsos o manipulados. La plataforma cuenta con la colaboración de Google News Initiative y la empresa española Minsait. Hasta el momento está disponible en las redacciones de PRISA Media en Colombia, México, Chile y España.

Básicamente, esta aplicación tiene como objetivo combatir la desinformación en el contenido sonoro, una amenaza creciente debido a los avances de la IA generativa.

La herramienta utiliza dos modelos avanzados de inteligencia artificial para evaluar la autenticidad de archivos de audio con contenido informativo. Los periodistas de PRISA Media pueden cargar un audio en la web de VerificAudio y recibir de forma inmediata una evaluación de la probabilidad de que el audio sea falso, complementando así los métodos tradicionales de verificación periodística y mejorando la detección de noticias falsas en formato audio.

El software puede detectar audios potencialmente manipulados o sintéticos gracias a su modelo de machine learning o aprendizaje automático. Además, si los periodistas disponen de un audio original de la persona implicada, pueden usar la herramienta para comparar y verificar si la voz ha sido clonada o es auténtica.

José Gutiérrez, director general de Soluciones, Digital y Tecnología de PRISA Media, destacó: «Este proyecto, que comenzó en Caracol Colombia y se está extendiendo a todas las redacciones de PRISA Media, parte del compromiso de PRISA en la lucha contra la desinformación y aboga por un periodismo de calidad». Gutiérrez resaltó que la tecnología es un arma fundamental en la lucha contra la desinformación y los deepfakes, y que la inteligencia artificial ofrece tanto oportunidades como riesgos que deben gestionarse.

¿Cómo funciona VerificAudio?

Olalla Novoa, periodista y gerente de productos de PRISA Media, explicó en un artículo del Reuters Institute los aspectos técnicos del desarrollo de esta aplicación, la cual es responsabilidad del área de Voice and Smart Speakers.

En primer lugar, se emplearon técnicas de procesamiento de lenguaje natural (similares a las usadas por ChatGPT y Bard) y aprendizaje profundo (deep learning) para evaluar manipulaciones en los audios. Se realizaron procesos de normalización y limpieza de los archivos, se evaluaron los algoritmos y finalmente se utilizaron redes neuronales y aprendizaje automático (machine learning).

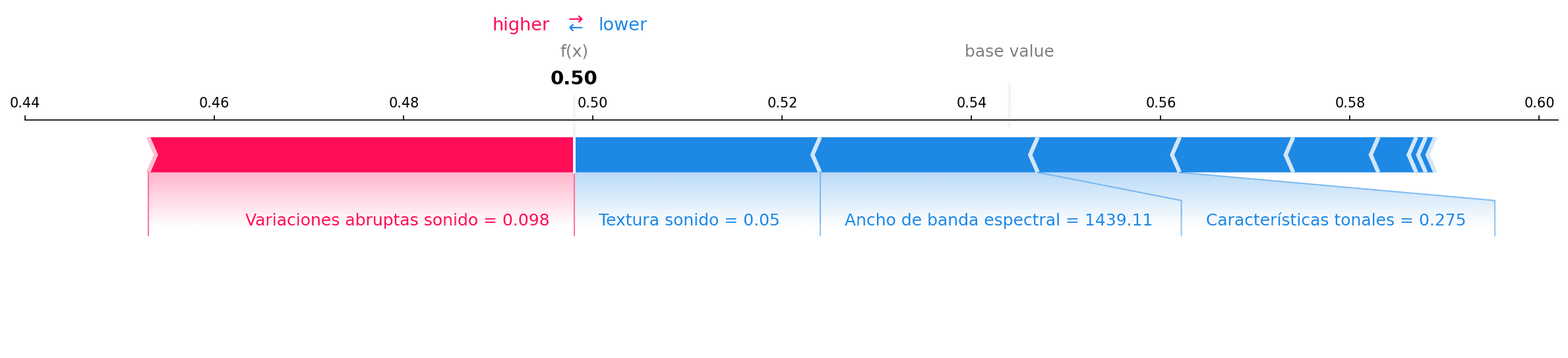

Los ingenieros desarrollaron parámetros específicos para analizar cada audio, enfocándose en características únicas de la voz como el tono, la entonación y los patrones del habla. Esto permite que la herramienta compare el audio con uno auténtico de la misma persona y determine si es la misma voz y si es real o generada sintéticamente.

Para mejorar la precisión de los resultados, VerificAudio utiliza un método de verificación doble con diferentes enfoques de inteligencia artificial, lo que permite rastrear y explicar cómo se llegó al resultado final. En la herramienta, un coeficiente f(x) menor a 0.35 indica que se trata de una voz genuina.

Para evitar falsos positivos, la herramienta fue entrenada con archivos de entrevistas radiales del Grupo PRISA y nuevas grabaciones de sus locutores. Los resultados se probaron tanto de forma automatizada como manual, con la ayuda de expertos humanos y diversas tecnologías para crear audios sintéticos.

Actualmente, el equipo detrás de esta IA está ampliando su base de datos para incluir distintos acentos de hablantes hispanos de todo el mundo, así como herramientas para falsificar audios y otros idiomas como gallego y catalán. En el futuro, se espera que la página web de la herramienta publique los análisis, combinando la verificación técnica con la revisión periodística de las distintas redacciones.

Como ya hemos comentado con otras aplicaciones como FotoForensics, ninguna herramienta de verificación debe ser utilizada como fuente indiscutible y definitiva. Es el trabajo de los reporteros acompañarlas de otras técnicas de investigación para llegar a conclusiones más certeras. Dicho esto, esta es una de las plataformas más precisas que existen actualmente, y que sea gestionada por periodistas y programadores la hace aún más segura.

Ejemplos prácticos

Aunque esta plataforma apenas tiene unos meses de vida, ya ha sido utilizada por algunos medios de comunicación de Latinoamérica.

El venezolano Efecto Cocuyo la empleó para desmontar una conversación falsa atribuida por el oficialismo a Edmundo González, candidato a la presidencia, y el opositor Juan Guaidó. De acuerdo con esta verificación la charla entre estas dos personas nunca ocurrió.

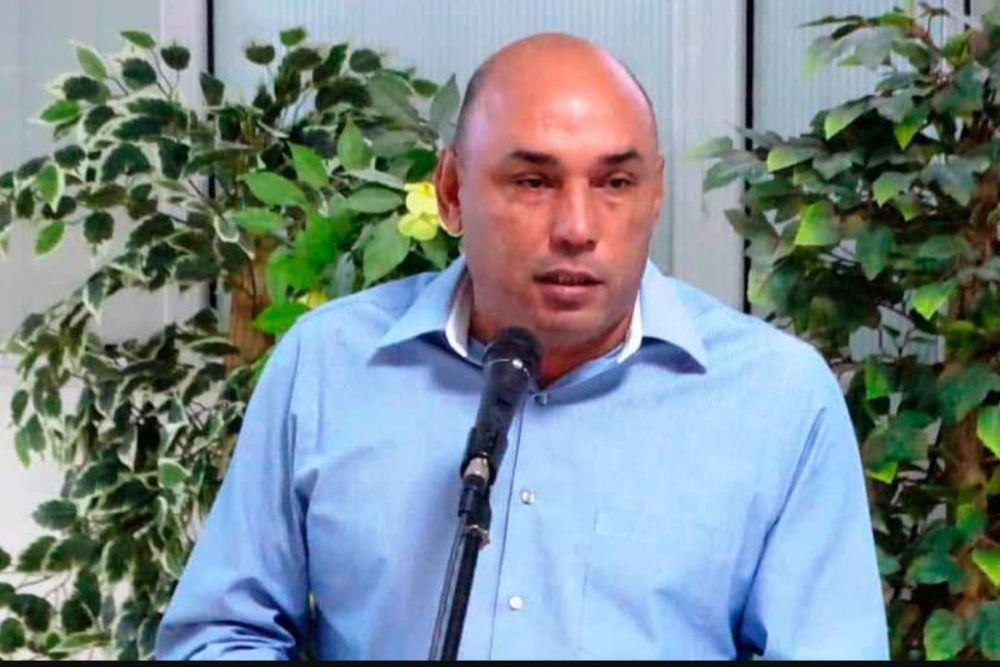

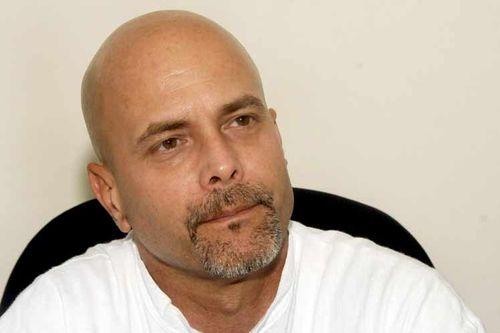

Martí Verifica también utilizó esta herramienta para chequear un mensaje supuestamente pronunciado por el gobernante Miguel Díaz-Canel sobre la escasez de pan en Cuba. El mensaje se difundió rápidamente entre TikTok e Instagram debido a un contexto donde sí era real la falta de harina para producir el pan.

Los expertos de VerificAudio compararon el audio viral con tres audios reales extraídos de Facebook y YouTube. La evaluación del contenido que hizo fue la siguiente:

Caso Miguel Mario Díaz-Canel Bermúdez:

Comparación con voz real 1: “Posibilidad de voz clonada”

Comparación con voz real 2: “Posibilidad de voz clonada”

Comparación con voz real 3: “Posibilidad de voz clonada”

El coeficiente F(x) del modo identificador es de: 0.50

Para la herramienta, una voz real se encuentra en valores inferiores a 0.35

Puede ver la verificación completa del audio viral en esta verificación.

Es decir, que el audio se encontraba 0.16 puntos por encima de lo que se considera una voz real.

Aunque por ahora la plataforma está disponible solo para las redacciones de PRISA Media se espera que pronto se extienda a otras redacciones y, eventualmente, a otros usuarios. Aún así, desde Martí Verifica te recomendamos acceder a su página web y dar clic en el enlace que dice «envía tu audio», que puedes ver en la captura de pantalla que muestra la interfaz de la aplicación. Esto abrirá un borrador en tu aplicación de correo electrónico donde debes dar los datos de la persona que quieras verificar y adjuntar el archivo del audio del que desconfíes. Al cabo de unos días, un periodista se pondrá en contacto contigo y te dará los resultados.

Fuentes consultadas

AI detection tools for audio deepfakes fall short. How 4 tools fare and what we can do instead

PARA DETECTAR SI UNA IMAGEN, AUDIO O DOCUMENTO ESTÁ CREADO CON INTELIGENCIA ARTIFICIAL

¿Qué son y cómo podemos identificar deepfakes?

PRISA Media lanza VerificAudio, una herramienta para detectar audios falsos

Audio viral atribuido a Díaz-Canel en TikTok no es real; aunque sí hay escasez en Cuba